PyTorch入门 人工智能魔法师の屋子的基础构建指南

在人工智能的广阔天地中,PyTorch如同一位现代魔法师手中的魔杖,以其灵活、直观的特性,赋予了开发者将算法构想变为现实模型的强大力量。本文将以《人工智能魔法师の屋子》在CSDN博客上的分享精神为引,带您从零开始,步入PyTorch与人工智能基础软件开发的世界。

第一章:PyTorch基础——魔法师的工具箱

1.1 什么是PyTorch?

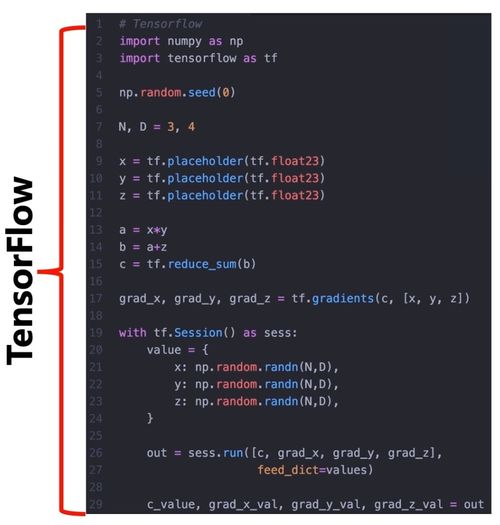

PyTorch是一个基于Python的开源机器学习库,由Facebook的人工智能研究院(FAIR)主导开发。它以其动态计算图(Dynamic Computation Graph)而闻名,这使得模型的构建和调试过程如同使用NumPy一样直观灵活,深受研究人员和开发者的喜爱。你可以将其视为搭建人工智能模型的“乐高积木”,提供了构建、训练和部署深度学习模型所需的核心组件。

1.2 核心概念:张量与计算图

- 张量(Tensor):PyTorch中的基本数据结构,可以看作是多维数组。它是所有运算的基石,类似于NumPy的ndarray,但强大的地方在于它可以运行在GPU上以加速计算。从简单的标量(0维张量)到复杂的多维数据(如图像、序列),一切皆可表示为张量。

- 动态计算图:PyTorch采用“定义-by-运行”的方式。这意味着计算图是在代码运行时动态构建的。这为模型带来了极大的灵活性,允许你在运行时改变图的结构,非常适合处理变长输入或进行复杂的控制流操作,这也是其被誉为“魔法”的重要原因之一。

1.3 环境搭建与第一个程序

在开始之前,你需要一个“魔法工作台”。通常,我们建议使用Anaconda来管理Python环境,并通过pip install torch torchvision命令安装PyTorch及其常用的视觉库。

让我们用一段简单的代码来点燃你的第一个“魔法火花”:`python

import torch

创建一个张量

x = torch.tensor([1.0, 2.0, 3.0])

print("张量 x:", x)

简单的张量运算

y = torch.tensor([4.0, 5.0, 6.0])

z = x + y

print("x + y =", z)

利用GPU加速(如果可用)

if torch.cuda.isavailable():

xgpu = x.cuda()

print("张量已移至GPU:", x_gpu.device)`

这段代码展示了张量的创建、基本运算以及如何利用GPU——这位魔法师的强大“使魔”来加速计算。

第二章:人工智能基础软件开发的基石

2.1 神经网络模块:torch.nn

PyTorch的torch.nn模块提供了构建神经网络所需的所有“预制构件”。你可以轻松地堆叠线性层(Linear)、卷积层(Conv2d)、激活函数(如ReLU)等,来搭建自己的网络架构。

2.2 自动求导:Autograd

这是PyTorch魔法的核心引擎。Autograd包自动为所有张量操作提供微分(求梯度)功能。你只需在创建张量时设置requires_grad=True,PyTorch便会跟踪在其上执行的所有操作,并在反向传播时自动计算梯度。这极大地简化了训练过程。

2.3 优化器与损失函数

训练模型就是不断调整参数以减少预测误差的过程。PyTorch在torch.optim中提供了各种优化算法(如SGD、Adam),在torch.nn中提供了多种损失函数(如MSELoss、CrossEntropyLoss)。它们与Autograd无缝协作,构成了模型训练的完整闭环。

第三章:构建你的第一个“魔法模型”——以线性回归为例

让我们将这些基础知识串联起来,实现一个简单的线性回归模型,这是你人工智能小屋的第一块砖瓦。

`python

import torch

import torch.nn as nn

import torch.optim as optim

1. 准备数据

xdata = torch.tensor([[1.0], [2.0], [3.0]])

ydata = torch.tensor([[2.0], [4.0], [6.0]]) # 假设关系是 y = 2x

2. 定义模型(一个线性层)

class LinearModel(nn.Module):

def init(self):

super(LinearModel, self).init()

self.linear = nn.Linear(1, 1) # 输入维度1,输出维度1

def forward(self, x):

return self.linear(x)

model = LinearModel()

3. 定义损失函数和优化器

criterion = nn.MSELoss() # 均方误差损失

optimizer = optim.SGD(model.parameters(), lr=0.01) # 随机梯度下降

4. 训练循环

for epoch in range(100):

# 前向传播

ypred = model(xdata)

loss = criterion(ypred, ydata)

# 反向传播与优化

optimizer.zero_grad() # 梯度清零

loss.backward() # 反向传播,计算梯度

optimizer.step() # 更新参数

if (epoch+1) % 20 == 0:

print(f'Epoch [{epoch+1}/100], Loss: {loss.item():.4f}')

5. 测试

print("训练完成,对输入4.0的预测:", model(torch.tensor([[4.0]])).item())`

从“屋子”到“殿堂”

本文作为《人工智能魔法师の屋子》系列的开篇,为你揭开了PyTorch基础与人工智能软件开发的第一层面纱。记住,熟练使用PyTorch就像魔法师熟悉自己的咒语和手势,需要不断的练习与探索。在CSDN博客等社区中,有无数像“魔法师の屋子”这样的分享者,他们的经验是你成长的宝贵养分。

你可以继续深入:探索卷积神经网络(CNN)处理图像,循环神经网络(RNN)处理序列,或了解如何部署你的模型。愿你在这个充满创造力与智慧的世界里,用PyTorch这座强大的桥梁,构建出属于自己的、惊艳的人工智能殿堂。魔法之旅,就此启程!

如若转载,请注明出处:http://www.zkkiss.com/product/41.html

更新时间:2026-04-14 11:34:23